日本の立命館大学の富山裕之教授のチームは、ロボットや自動運転車が小さな3Dオブジェクトを正確に検出および識別できる技術を開発したと発表した。

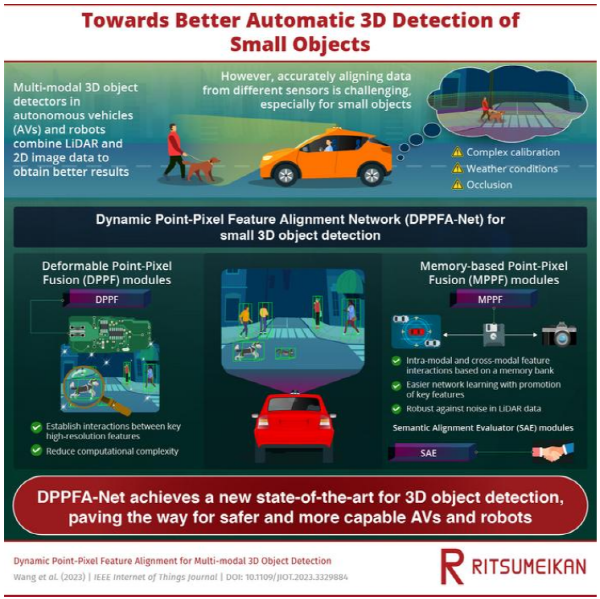

研究チームによると、自動運転ロボットや自動車は周囲の3D物体を素早く検出する必要があるという。 ほとんどの 3D オブジェクト検出方法は、LiDAR センサーを使用して周囲環境の 3D 点群を作成します。 ただし、LIDAR はノイズに非常に敏感であるため、雨などの悪天候ではエラーが発生する可能性があります。

この問題を解決するために、科学者たちは、3D LIDAR データと標準カメラでキャプチャされた 2D RGB 画像を組み合わせたマルチモーダル 3D 物体検出方法を開発しました。 2D画像と3D LiDARデータを融合することで、より正確な3D検出計測結果が得られますが、小さな物体を正確に検出することは依然として困難です。

富山裕之教授のチームは、3D オブジェクトのマルチモーダル検出をより正確かつ強力にする革新的なアプローチを開発したと発表しました。 そして昨年11月3日、専門学術誌「IEEE Internet of Things Journal」で「DPPFA-Net(Dynamic Point-Pixel Feature Alignment Network)」と呼ばれる技術が提案された。

このモデルには、メモリベースのポイント ピクセル フュージョン (MPPF) モジュール、変形可能なポイント ピクセル フュージョン (DPPF) モジュール、およびセマンティック アライメント エバリュエーター (SAE) モジュールが含まれています。 これは 3 つのモジュールに基づいています。これにより、ノイズ問題に対してはるかに堅牢なシステムが作成され、2 つのデータ表現間のセマンティックな整合性が確保されることで曖昧さの問題が軽減されます。

研究チームがこの技術をテストしたところ、さまざまなノイズ条件下で平均 7.18% の精度向上が達成されたことがわかりました。

「インターネット狂信者。邪悪な主催者。テレビ狂信者。探検家。流行に敏感なソーシャルメディア中毒者。認定食品専門家。」